阿里巴巴个人助手智能体CoPaw搭建

开源项目openClaw从年初火到了现在。最初我也想更一波风,体验一下这个智能体工具的效果,但是安装脚本一直有点问题(怀疑和nodejs有关),加上最近比较忙,所以就不了了之了。

某天突然在小红书上看见一条新闻,阿里巴巴也推出了一款openClaw的类似物,叫做CoPaw。根据小红书笔记上的介绍,这个智能体助手的功能和openClaw非常相似,并且可以无缝对接QQ、飞书、钉钉等国内软件的生态,看起来要比openClaw方便一点。

因此,利用元宵节的空闲时间(大家元宵节快乐啊!!!),成功在魔搭社区(modelscope)的创空间里配置起来了CoPaw。虽然还没完全探索完它的功能,但是CoPaw的强大能力已经足够让人惊叹了。

我们要干什么:通过魔搭创空间免费安装CoPaw

参考CoPaw的官方文档:https://copaw.agentscope.io/docs/quickstart

在文档中,提到了可以在魔搭创空间 中一键部署安装(如下图)。魔搭是阿里云旗下的一个开源编程社区,而创空间是魔搭为创业者、创新者、艺术家和爱好者提供交流、合作和展示创意的平台。关于魔搭创空间的使用,也可以参考DataWhaler社区的一篇教程《魔搭创空间部署教程》

step1 魔搭创空间一键配置

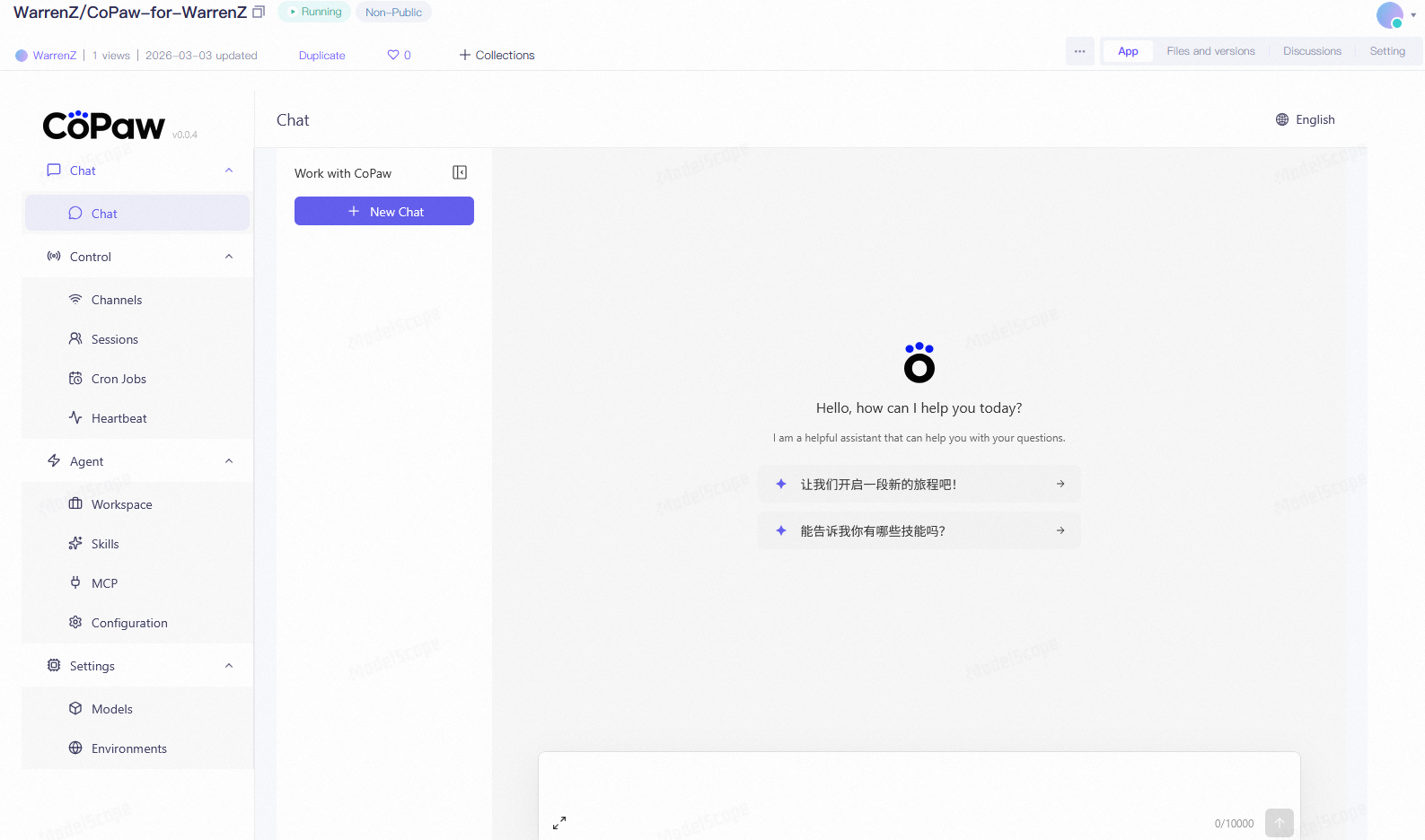

魔搭创空间的“一键配置”确实是一键配置。按照CoPaw文档中给出的链接,注册魔搭账号后选择一键配置,等待几分钟(用户什么都不用做!)以后就部署好了!如下图:

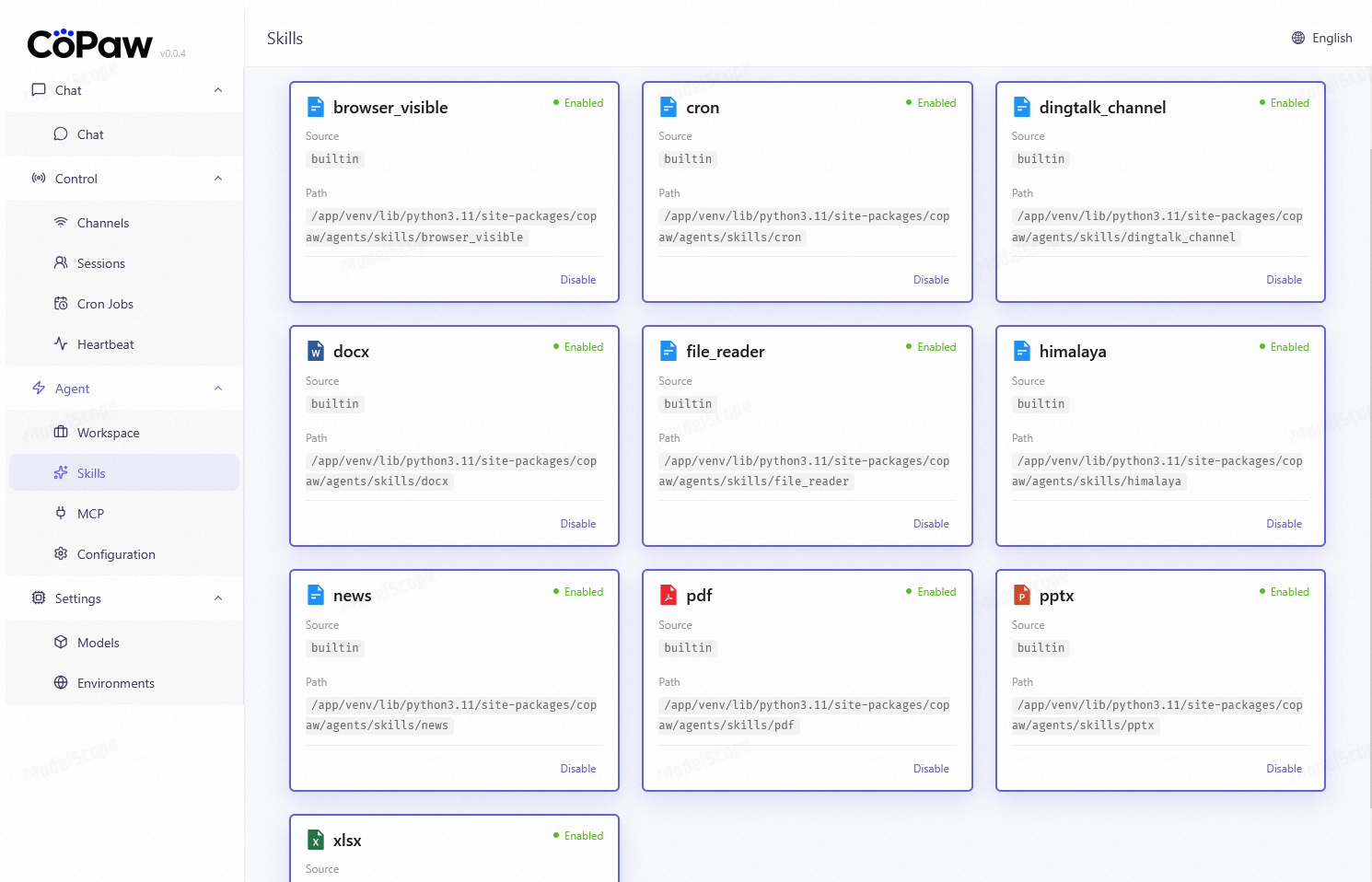

下图展示了内置的Skills

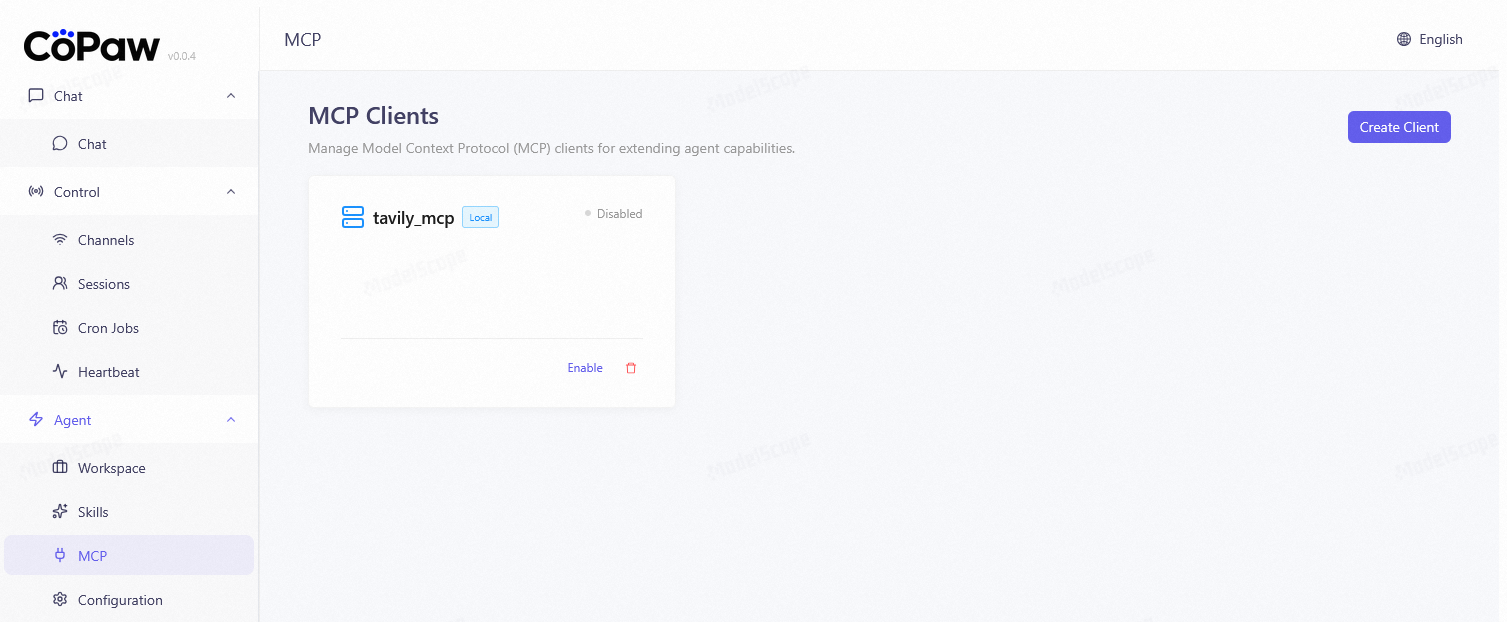

step2 添加MCP工具

内置的MCP工具不多(只有一个tavily在线搜索工具),但是我们可以自行添加更多的MCP工具。关于MCP工具的原理,见博客往期文章《大模型MCP简介》 ;CoPaw添加MCP的方法是从json导入,这种方法与cherry studio添加MCP的方法类似,可以参考博客往期文章《在cherry studio中启用MCP》 。

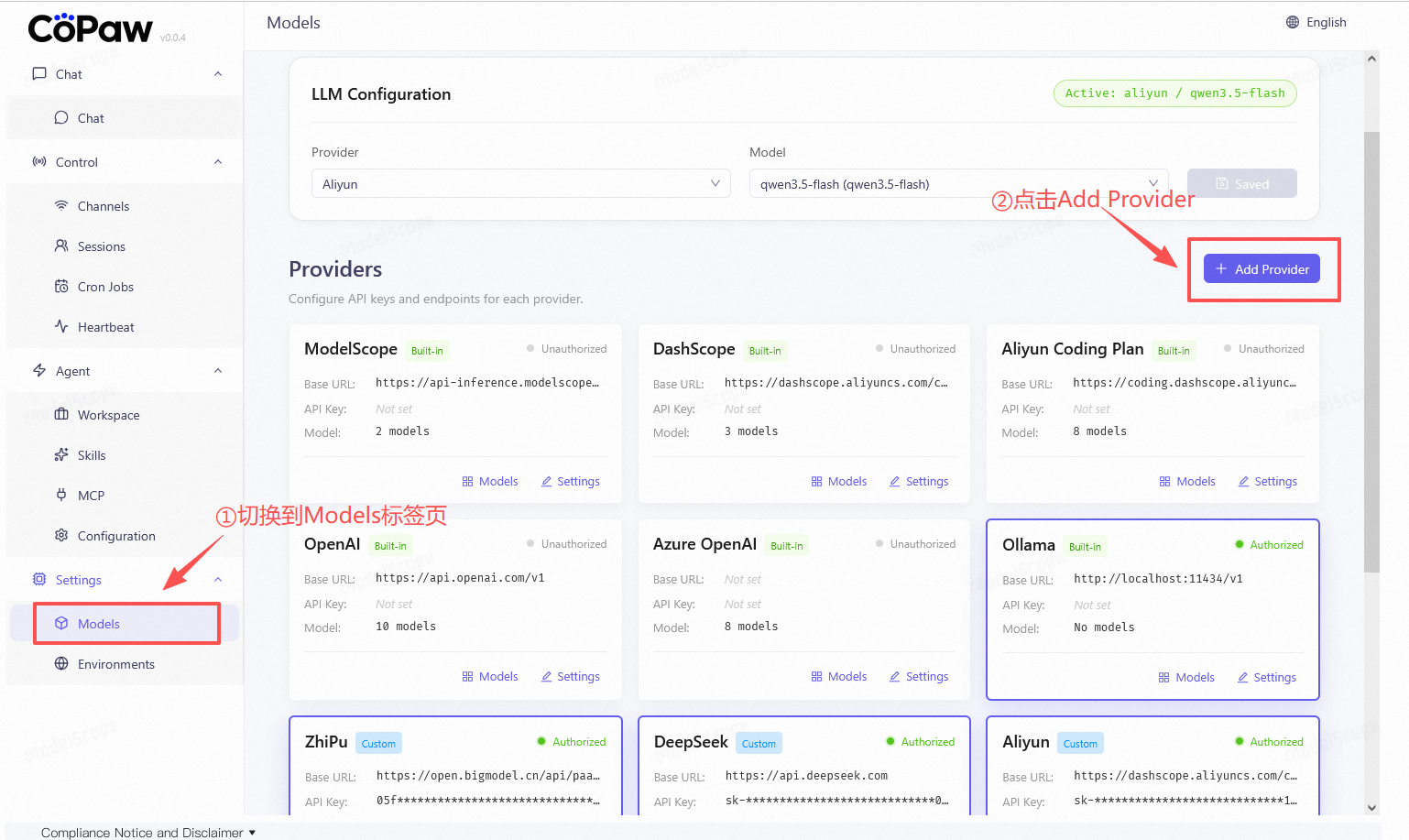

step3 配置模型

CoPaw默认的模型是Ollama本地大模型。但是在魔搭创空间上,Ollama带不动高性能大模型,我们需要配置一下云端大模型的接入才可以。

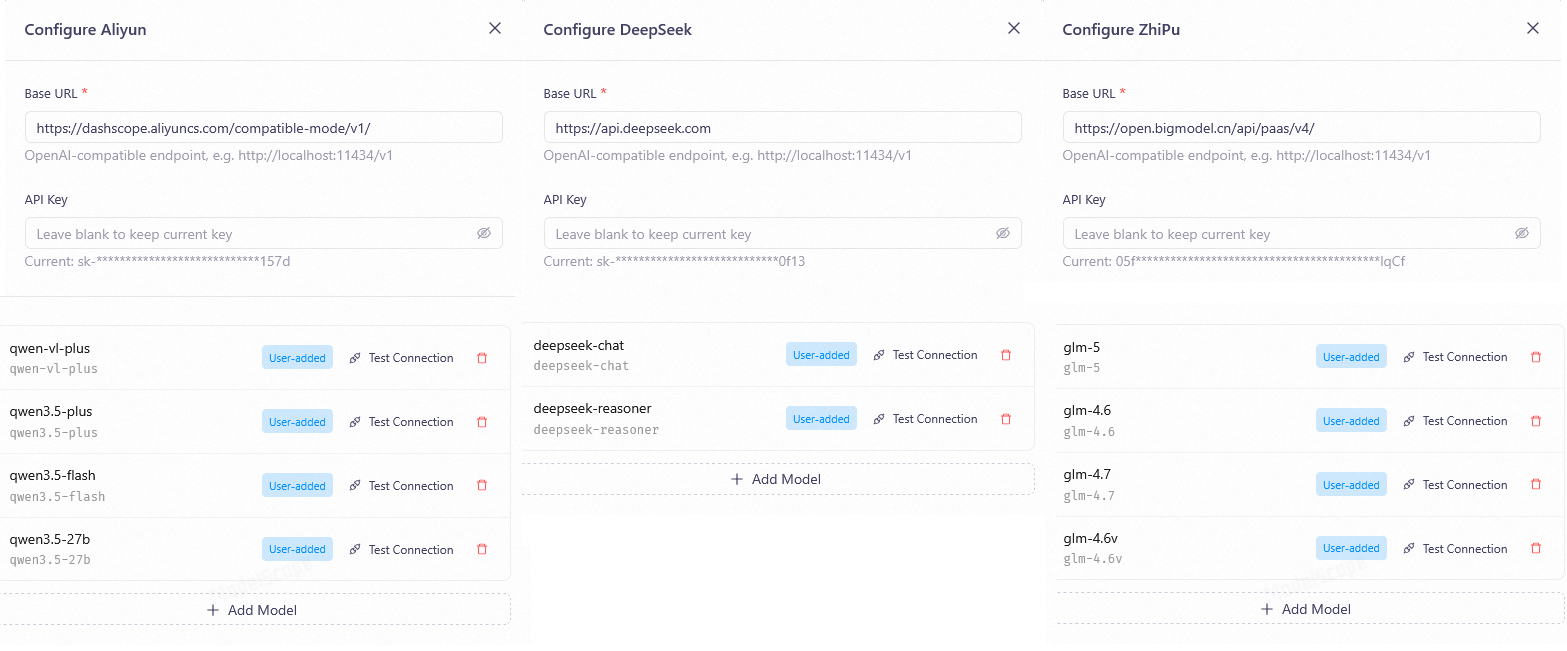

如下图,配置模型环节,这里点击Add provider可以添加新的模型供应商,这里读者朋友们可以根据自己习惯使用的模型,添加包括DeepSeek、智谱大模型、阿里云Qwen系列模型等供应商。

需要注意,每次添加完供应商以后,第一次点击测试链接可能会报错“invalid URL or KEY”,这个时候重新添加一下API KEY即可。在测试链接成功以后,方可添加模型ID。

下图是我配置好的云端大模型(这里面的URL可以参考我的填法,API KEY需要自己申请)。默认的模型可以选阿里云的qwen-3.5-flash,这是阿里巴巴通义千问团队近期推出的新一代Qwen大模型,在性能和资费上取得了不错的平衡。

step4 第一次聊天

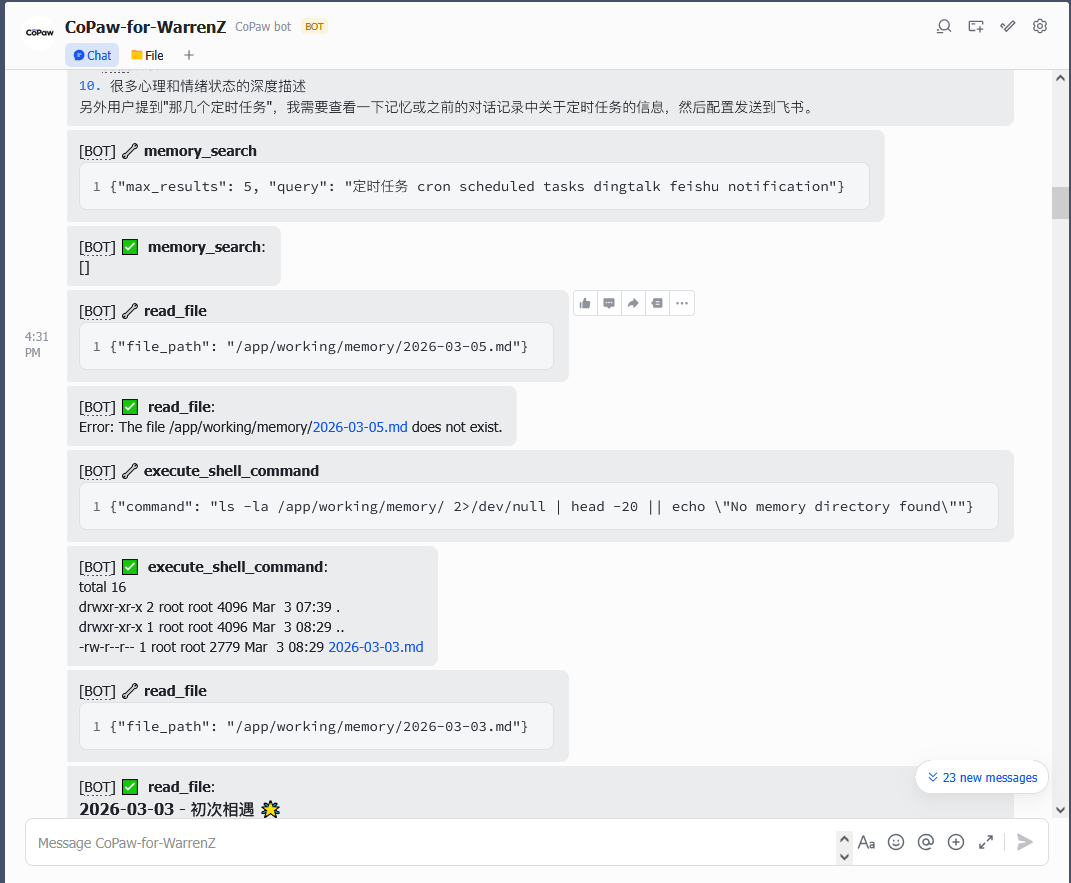

切换到Chat标签页,随便打一打招呼。在这里,可以多说一说自己的信息,以便CoPaw生成个性化的personal memory长期记忆文档(就和openClaw一样)。长期记忆文档是保存在本地的(在我们的例子中,就是保存在魔搭创空间的私有云存储空间里的,只要这个创空间不对外公开,其他人无法了解长期记忆文档的内容)。

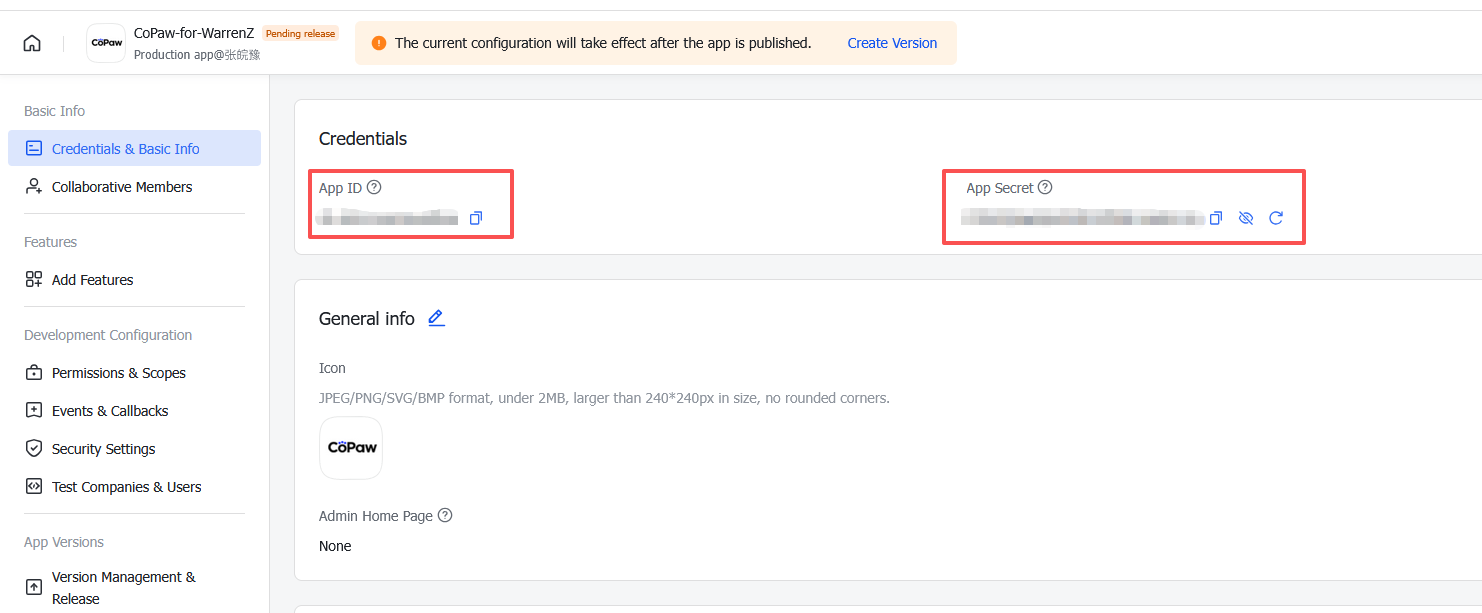

step5 接入飞书、钉钉等app生态

这一块的具体方法参考 CoPaw官方文档 。

以飞书为例,我们首先需要进入飞书开发者平台,新建一个APP,然后记录下App ID和App secret这两个凭证信息:

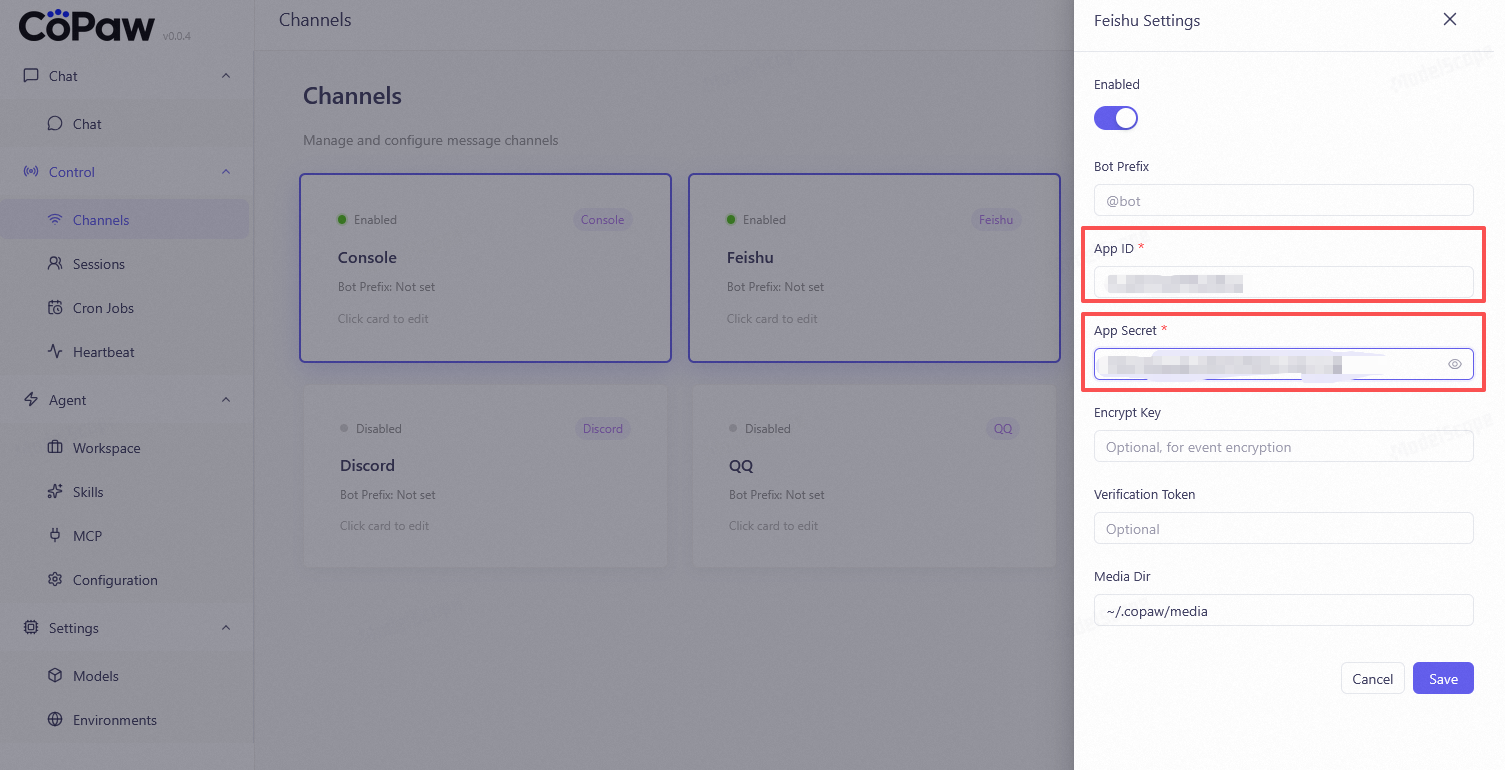

随后切回CoPaw,在Channel设置中找到Feishu设置,填入App ID和App Secret两个凭证:

后续还有许多步内容,限于篇幅此处省略,读者朋友可以参考CoPaw官方文档的飞书配置 。

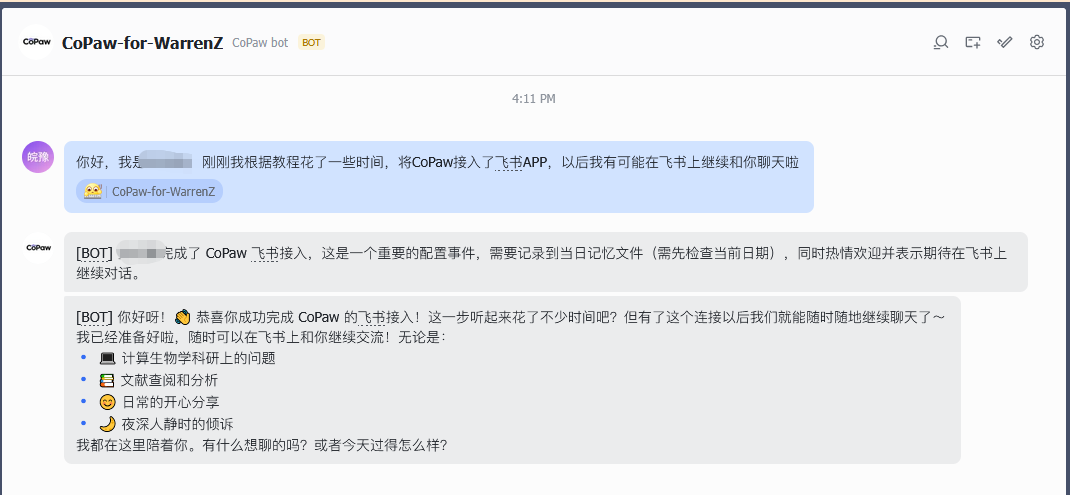

最终接入以后的效果:

完结撒花!

后记

- 不论是openClaw还是CoPaw,聊天过程对于token的消耗量都是巨大的(远超一般的网页版AI对话窗口),因此强烈建议配置前查询清楚模型价格,使用一些便宜的模型如qwen-flash,deepseek-chat等进行操作,或者使用包月的AI-coding服务包(如qwen-coding-plan或glm-coding-plan),以降低使用成本。

- 魔搭创空间上的CoPaw虽然是一个云服务器(底层是docker),但内部文件系统封闭不对外开放,想要直接修改底层文件很难,只能通过对话调用工具间接访问底层文件,算是一个小小的缺点。

- 笔者测试了接入飞书和QQ这两个app,其中飞书支持用户向CoPaw发送图片和文件(其实原则上也支持CoPaw发送文件给我;但是不知为何实际使用中CoPaw并不能向用户发送文件),而QQ只能聊天,不能发图片和文件,因此涉及文件上传的工作建议用飞书。